こんにちは。

今回はHermes Agentを使って自分だけのAIエージェントを作る方法と使い方について紹介します。

AIの発展はまだまだ終わりそうにありませんね。

AIの回答の質や精度が向上するだけでなく、近年では小型化や軽量化などIoTやフィジカルAIへの組み込み対応、機密保持の観点ではローカル化やパーソナル化が進んでおります。

普段AIを活用している皆様にも、そのような観点で使ってみたいというご要望はありませんか?

特に「自分専用のAI」とか「自分が関心のある領域に詳しいAI」というパーソナルAIを作ってみるのはいかがでしょう。

私も最近触り始めたのが「Hermes Agent」です。

でもこういうAIエージェントって

なんか難しそうだな・・。自分では扱えそうにないな・・

でもお高いんでしょう?

大丈夫です!簡単で無料で使えます!

設定方法から基本的な使い方までを手順を追って解説しますので、ご興味がありましたらおつきあいください。

それではよろしくお願いします。

Hermes Agentとは?

Hermes Agentは、Nous Research社が開発した自己改善型AIエージェントです。

単なる一問一答のチャットボットとは異なり、与えられたタスクに対して自律的にプロセスを考え、「自己改善(Self-improving)」を行いながら結果を導き出す能力を持っているのが最大の特徴です。

今まではパーソナライズするためには、特定の情報を蓄積して渡すRAGのような技術だったり、MCPサーバーという外部情報を参照させる仕組みを自分で構築する必要がありました。

Hermes Agentはこれらの機能を最初から持っており、使いこめば使い込むほど、自律的に必要な情報を蓄積し、会話内容から学習して柔軟に調整してくれます。

OllamaとGeminiを活用する

冒頭のHermes Agentのリンクを見てもらうと、セットアップから使うまでのハードルが高いように感じます。

そこでより簡単にするためにOllamaを使います。

どんなAIモデルが使えるか?

Hermes Agentで動くAIモデルを選択する必要があります。

機密性重視の場合、ローカルLLMが使えるOllamaがおすすめです。

Hermes Agentは深く考えてMCPサーバーなど色んな道具を使えます。

よって使うモデルはthinkingとtoolsが扱える性能の高いAIモデルが求められるため、ハイスペックなPCが求められます。

本記事ではOllama CloudやGeminiのAPIを推奨します。

高性能モデルを無料APIで利用することができます。

ただし無料APIの場合、データが学習に使われるため機密情報は扱わないように注意しましょう。

それではセットアップの手順を紹介します。

Ollamaのインストール

Windowsの場合

Windowsの方はひと手間ですが、Hermes AgentはWSL上でしか動かせないようです。

いつかWindows上で動かせるようになってほしいですね。。

もしWSL2のインストールがまだの方は、コマンドプロンプト(シェル)で以下のコマンドでインストールしてください。

wsl --installWSL2の設定の詳細については割愛しますが、以下のリンクや他記事を参照ください。

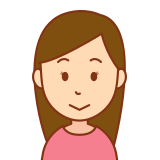

インストールが完了したらコマンドプロンプトで以下のコマンドを入力しWSLを起動しましょう。

wsl上手く起動できればこんな感じ。

起動を確認したら、以下のコマンドでollamaをインストールしましょう。

curl -fsSL https://ollama.com/install.sh | sh途中zstdなど追加のインストールを求められたら、メッセージに従ってインストールしてください。

Mac、Linuxの場合

macやLinuxの方は、以下のリンクから「Download for mac」ボタンからダウンロードしてインストールしてください。

現状Hermes Agentを使うなら、一番簡単なのはMacでしょうね。。

Windowsは今後コマンドプロンプト→WSLの手順を踏むことになるのでちょっと面倒です。

Ollamaモデルのダウンロード

ではollamaがうまくインストールできたかどうか、OllamaでサポートしているAIモデルをインストールしてみましょう。

wslまたはコマンドシェルを起動してください。

Hermes Agentはthinkingとtoolsのモデルを推奨するため、候補としては以下が対象となります。

- gemma4 26B (17GB)

- qwen3.5 27B (17GB)

- gpt-oss 20B (13GB)

- deepseek-r1 32B (20GB)

見てもらうとわかる通り、ローカルモデルはどれもサイズが大きいですね。

本記事での推奨はOllama CloudかGemini APIとするため、gemma4のCloudモデル(31B)を使います。

以下のコマンドでインストールします。

ollama pull gemma4:31b-cloud無事にインストールが開始・完了されればOKです。

Hermes Agentのインストール(Ollama経由)

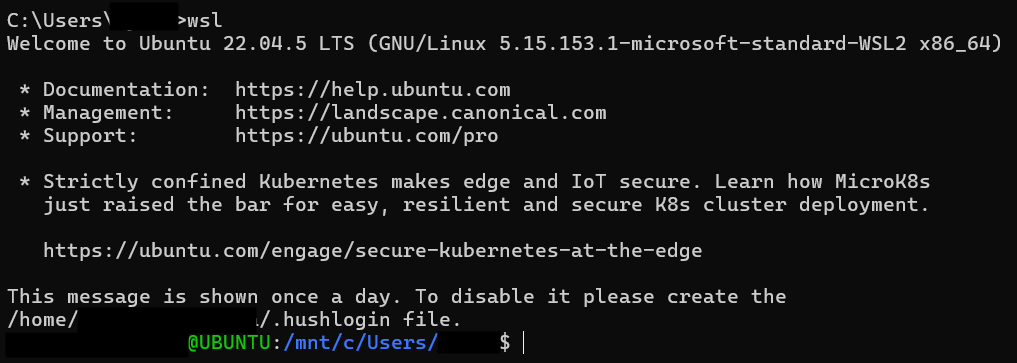

wslで以下のコマンドを入力します。

ollama launch hermes必要な依存関係のインストールが始まりますので、YesでOKです。

インストールが完了するとAIモデルを選択する画面になるので、先ほどダウンロードしたgemma4 を設定します。(後ほどモデルの変更の仕方も説明します)

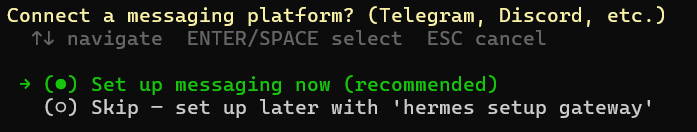

メッセージツールやゲートウェイの設定もありますが、任意で設定ください。

本記事ではSkipとします。

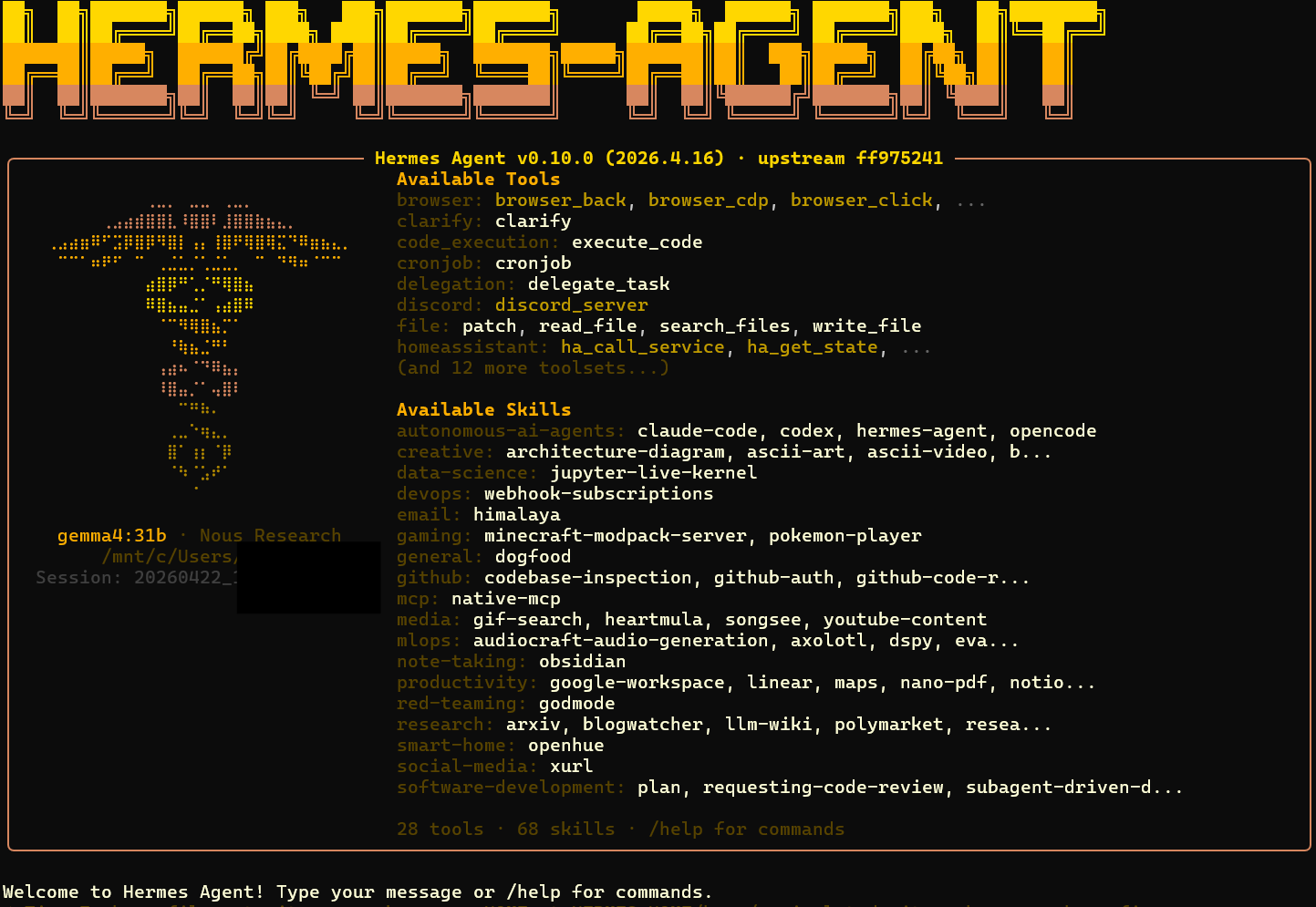

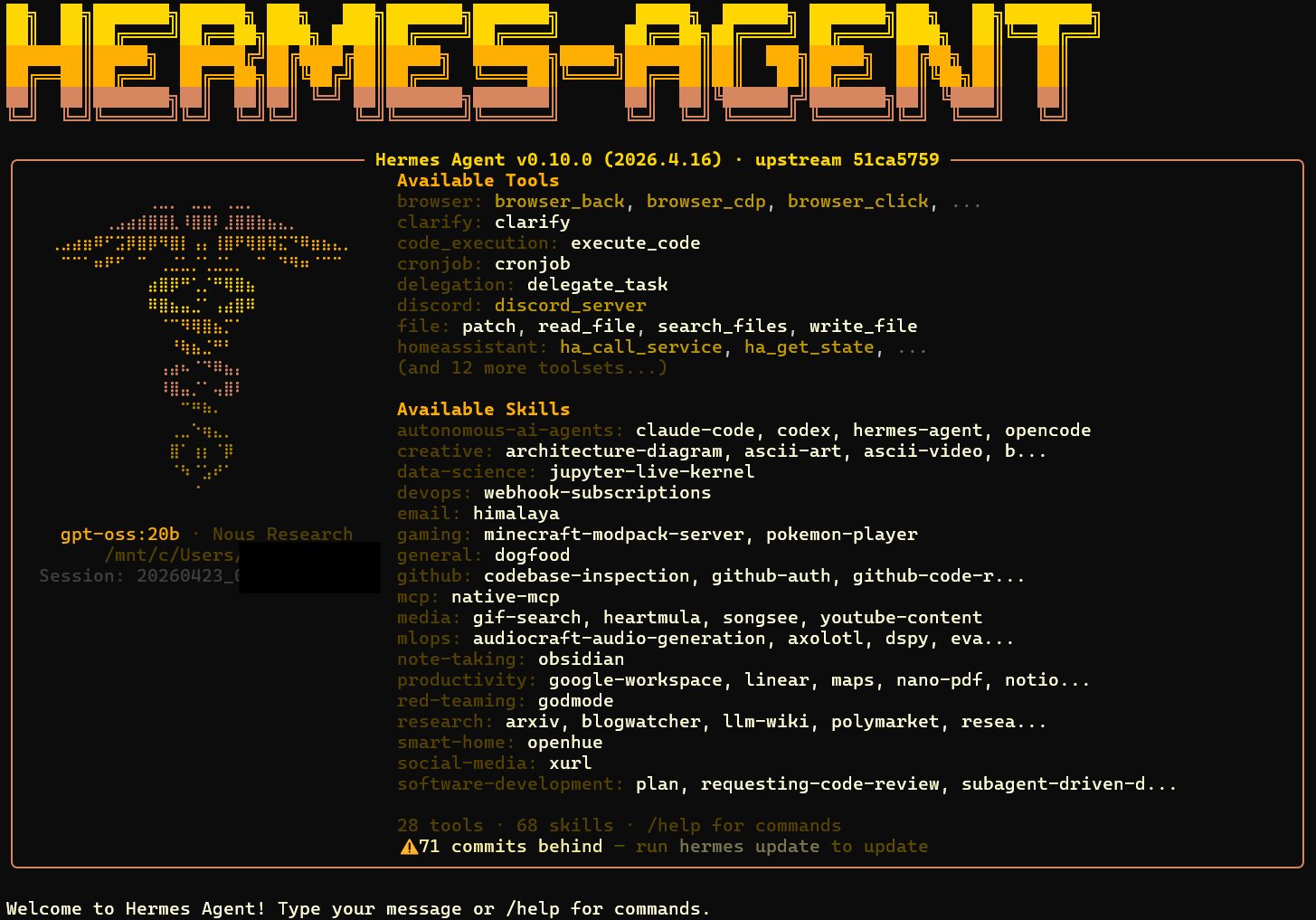

すべての設定、インストールが完了すると以下のようにHermes Agentが起動します。

これでHermes Agentの設定は完了です。

終了する際はCtrl + Cでチャットを終了します。

次回以降はコマンドで「hermes」と打つだけで起動可能となります。

Hermes Agentの設定(AIモデルの変更)

以下のコマンドでHermes Agentを設定できます。

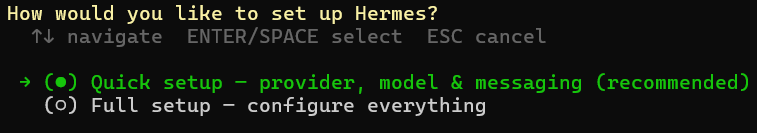

hermes setup

Quick setupを選ぶと「モデルの変更」→「メッセージアプリの設定」ができます。

「メッセージアプリの設定」はSkipするため、モデルの変更のみです。

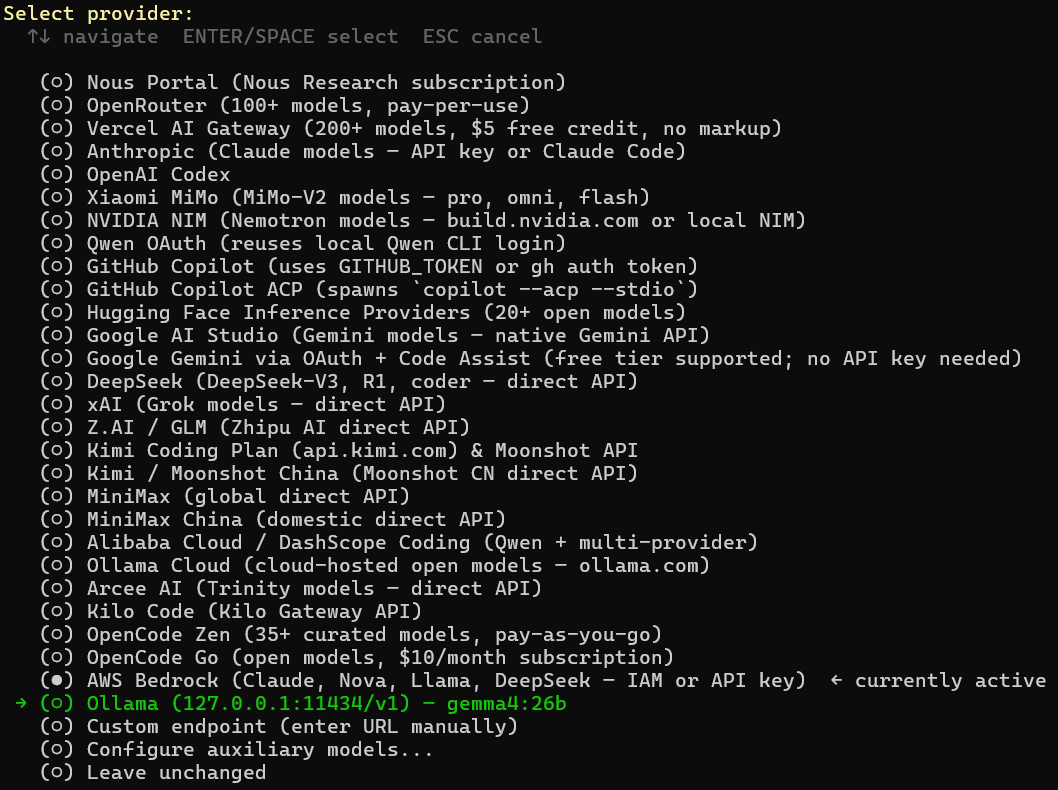

エンターすると、以下のようなSelect provider画面になります。

以下3パターン紹介しますが、お好きなものを選んでください。

本記事ではOllama Cloudモデルで進めます。

Ollama Cloudモデルに変更する

Ollama Cloudモデルをまずはダウンロードしましょう。

以下のページから「Cloud」でフィルタリングすると検索しやすいです。

ではgpt-ossのCloudモデルを以下のコマンドでダウンロードしましょう。

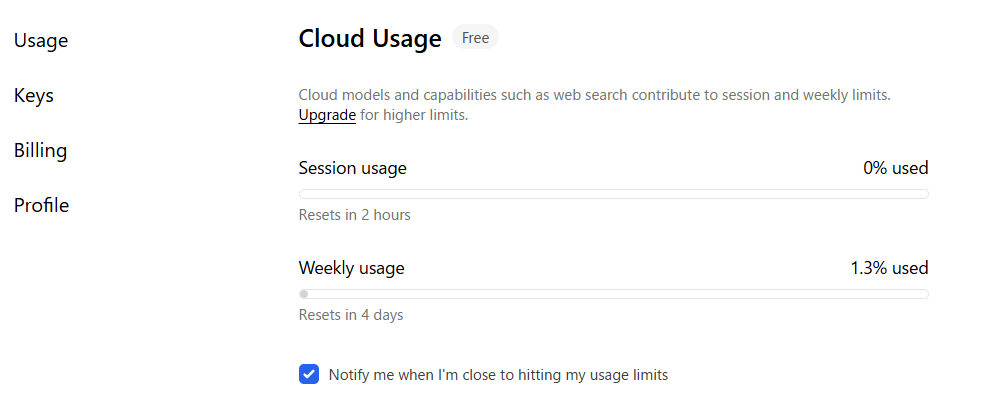

ollama pull qwen3.5:cloudダウンロードが完了したら、Cloudモデルを使用するためのAPIキーを作成する必要があります。

以下のOllamaページの右上の「Sign in」からアカウントを作成しましょう。Googleアカウントなどですぐ作成できます。

ログインするとアカウント(Settings)の左側に「keys」をクリック。

中央に「Add API key」ボタンがあるので、任意の名前をつけて作成します。

このAPI keyをコピーしておきます。

先ほどのSelect provider画面の「Ollama Cloud (cloud-hosted open models — ollama.com)」を選択してください。

Ollama Cloud API keyが求められますので、先ほどコピーしたAPIキーを貼り付けてください。

貼り付けたものが見えないかもしれませんが、一回貼れたらOKなので気にせずエンター。

Base URLは空欄でエンター。

すると使えるCloudモデル一覧が出るのでgpt-oss:20bを選びます。

次にmessaging platformについて聞かれますが、Skipします。

これで設定完了です。

そのままHermesを起動するか聞かれるので、起動したい場合はYを入力してエンター。

真ん中のシンボルあたりのモデルがgpt-oss:20bに変わっていればOKです。

大きな流れはこのようなもので、他providerでも大体一緒です。

OllamaのローカルLLMに変更する

先ほどのOllama Modelsの「Cloud」ではないモデルをダウンロードします。

サイズが大きいのでダウンロードに時間がかかりますが、コマンド例は以下です。

ollama pull gpt-oss:20bSelect providerからOllamaまたはCustom endpointを選びます。

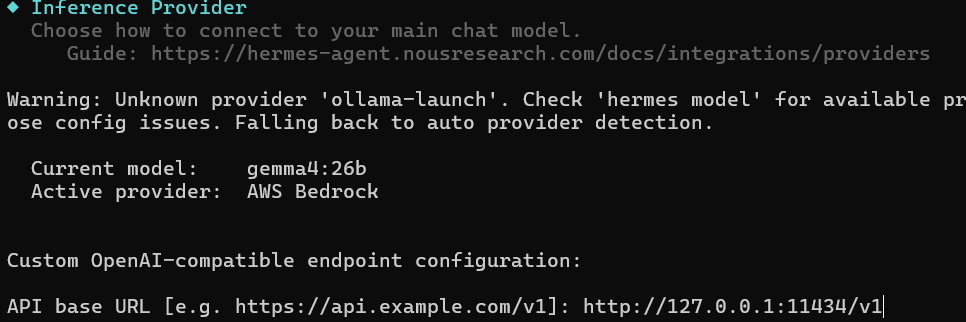

今回はCustom endpointについて紹介します。

API base URLに「http://127.0.0.1:11434/v1」を貼り付けます。

API key [optional]、Context length in tokens、は特に何も入力せずエンター。

すると既にダウンロード済モデルの一覧が表示されるので、使いたいものを選びます。

あとは先ほどのOllama Cloudと同様です。

Gemini APIモデルに変更する

あらかじめGoogle AI StudioでGeminiのAPIキーを作成しましょう。

作成の仕方がわからない場合は以下の記事を参照ください。

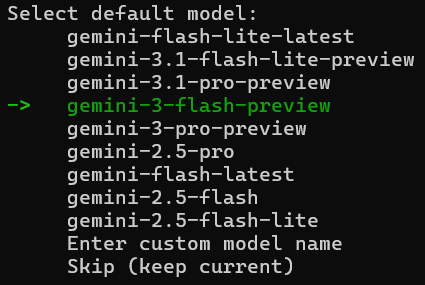

Select providerからGoogle AI Studio (Gemini models — native Gemini API)を選択します。

あとはOllama Cloudと大体同じです。

GOOGLE_API_KEYに取得したAPIキーを入力します。

Base URLは空欄でエンター。

すると使用可能なモデル一覧が出るので、お好きなものを選んでください。

あとは先ほどのOllama Cloudと同様です。

実際の使い方

さて使い方ですが、普段ChatGPTやGeminiの使い方で気楽にチャットしてもらってOKです。

ポイントとしては自分のPC内のファイル・フォルダ探索が可能であり、ネットから情報を探索させることも可能なので、そんな使い方を意識してみてください。

自分の情報に特化させて使い込むようなユースケースにはどのようなものがあるか、考えてみましょう。

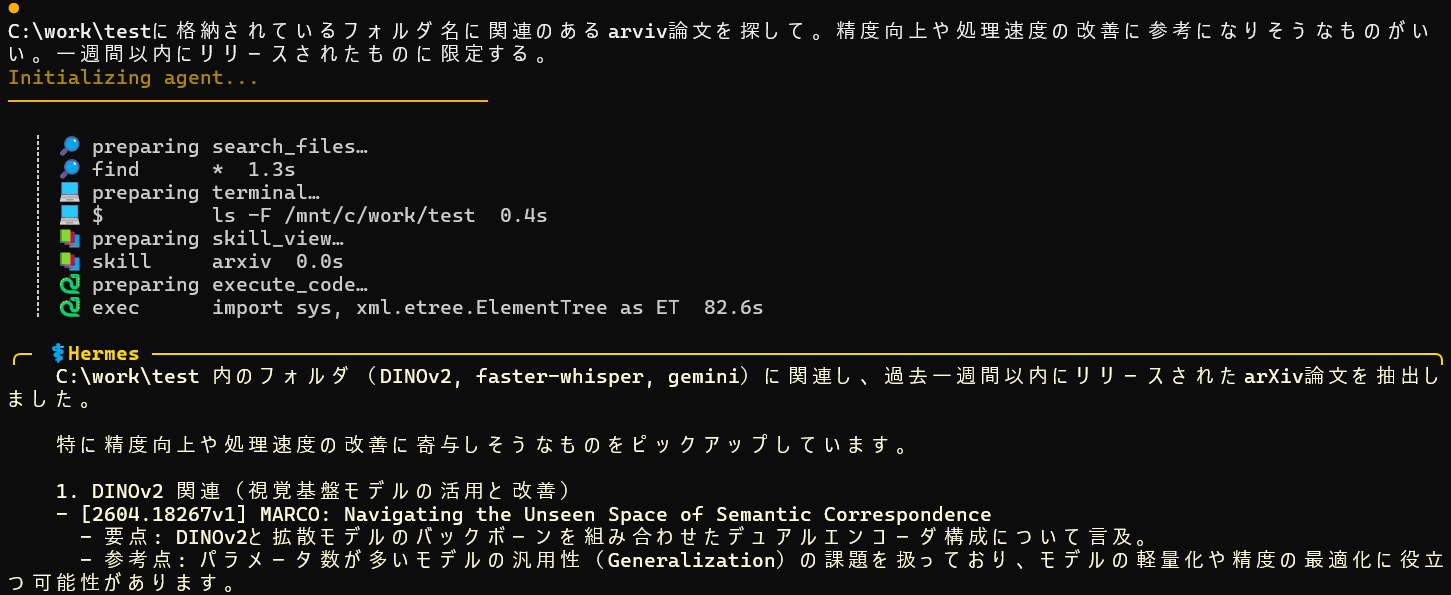

参考例として私のケースをひとつあげると、私は業務に必要なAI技術の論文調査などを定期的に行っています。

特化型論文探索

AI論文といっても様々な分野があるので、私の業務や興味に関係のある分野だけ探索してもらいたいです。

そういうこった作業を手動でやるのって結構大変だと思いませんか?

ググる時の手間もそうですが、さらに関連がありそうかどうかも見ながら探していると時間がかかります。

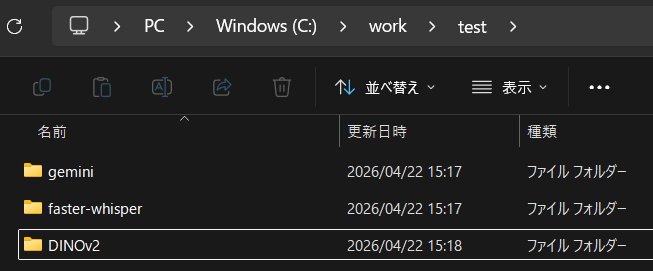

例えば以下のように、自分の開発プロジェクトや作業ディレクトリがフォルダ毎に分かれているとします。

このフォルダのパスを渡して、フォルダ名を確認できるか見てみましょう。

ちゃんとローカルフォルダの名前を認識していますね。

検索結果もそれらに関連するものを探してくれています。

しかし肝心のURLがありません。

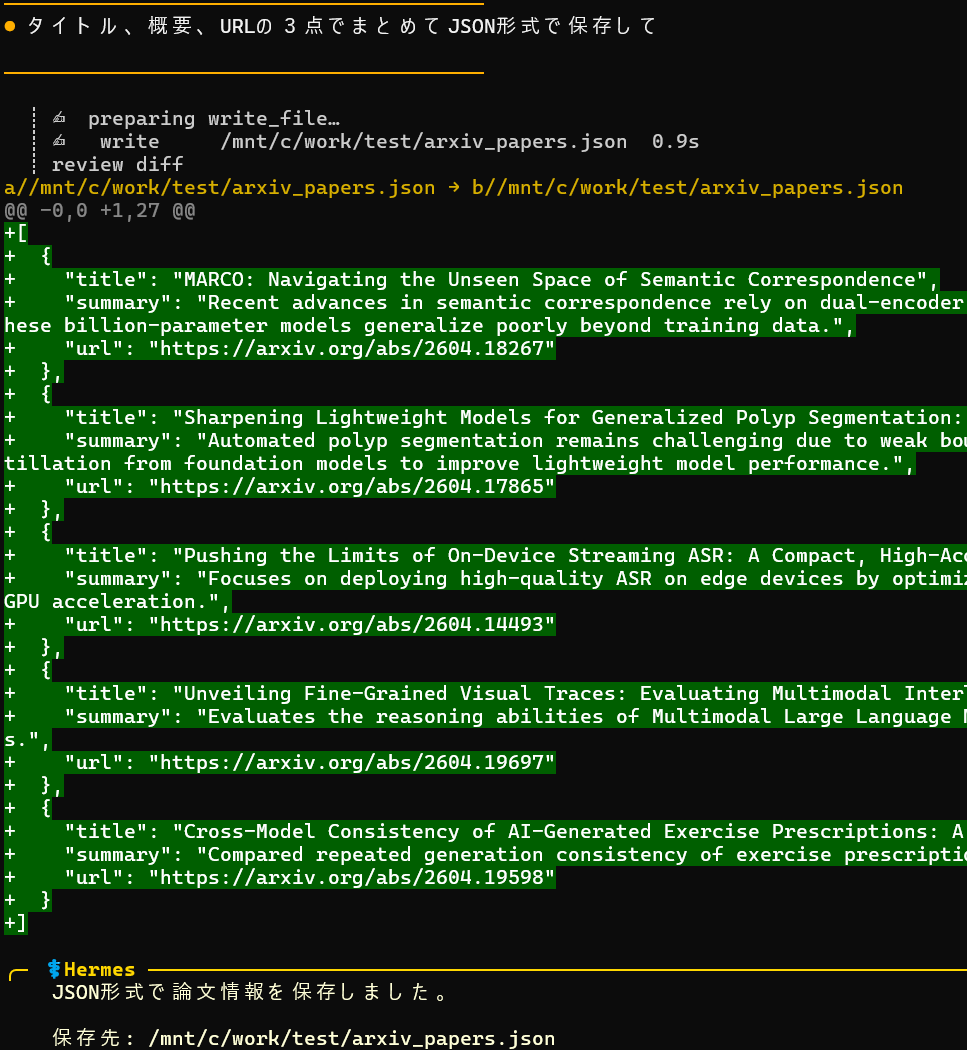

出力構造と形式を指定して保存までやってもらいましょう。

URLも正しいものが追加され、検索結果をJSONで保存してくれました。

ただこれだとどのフォルダにどの論文が関連してるかわかりませんね。

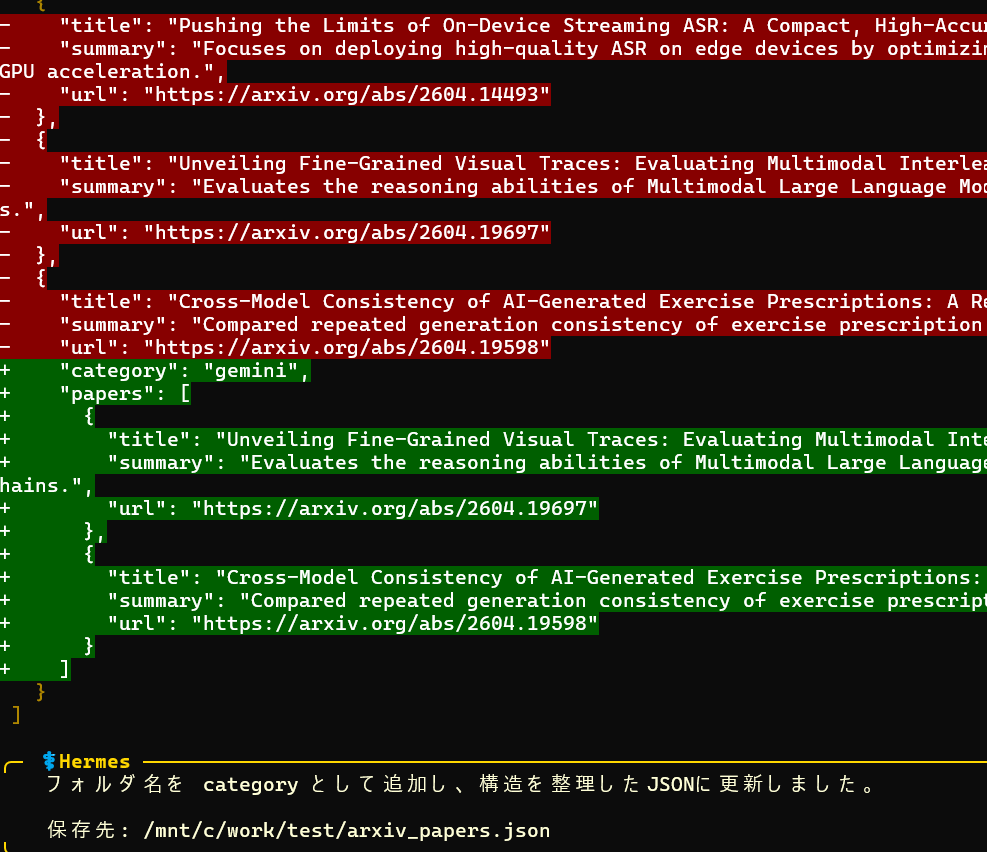

JSON形式を見直してもらいましょう。

良さそうです。

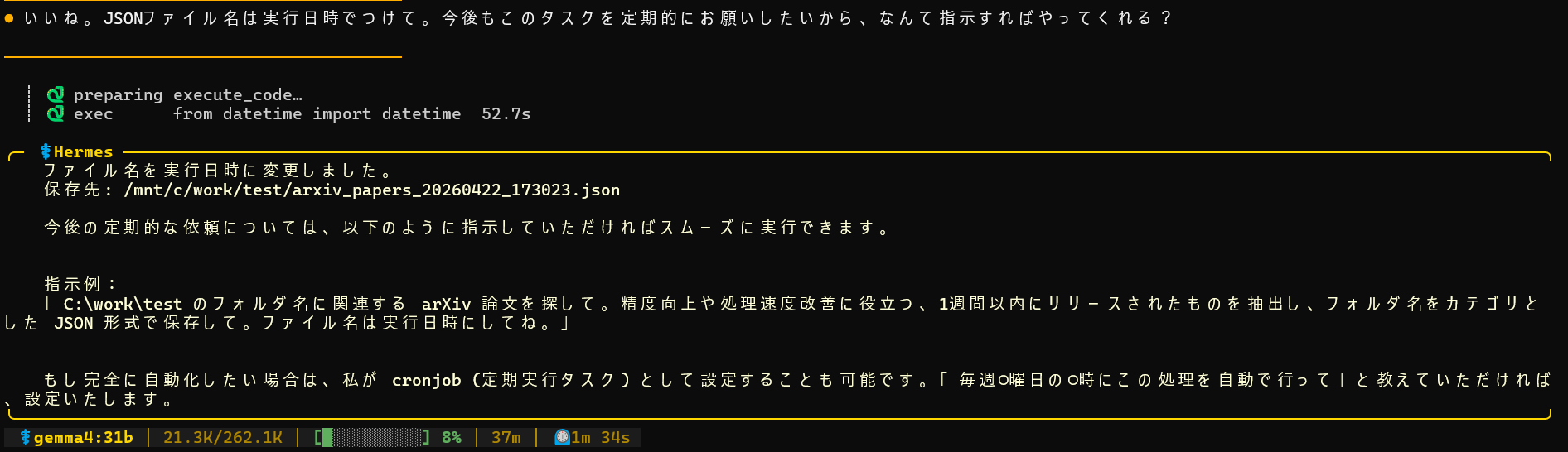

あとは定期実行を想定しているので、JSONファイル名を実行日時にしてもらいましょう。

Hermes Agentの良いポイントとしてcronjob(定期実行)するタスクとして記憶してくれるので、このように提案してくれるのはいいですね。

こちらが何か設定する必要はなく、チャットだけで完結します。

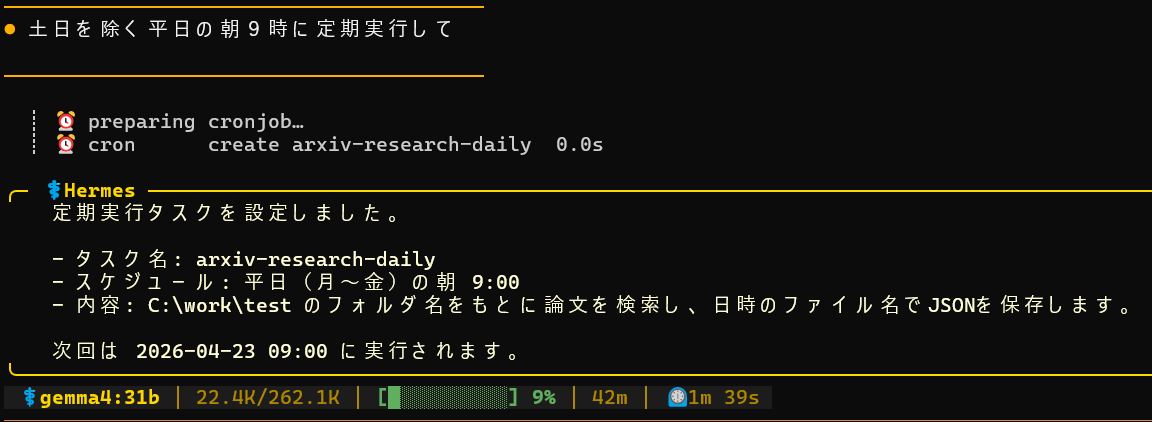

土日を除く平日の朝9時に定期実行するようにしてもらいましょう。

定期実行してもらうにはゲートウェイ設定が必要!(2026/5/20追記)

さてバックグラウンドで実行してもらうためにはゲートウェイの設定が必要です。

Hermesの環境変数でまずはゲートウェイを有効化します。

以下のコマンドでフォルダに移動します。

cd ~/.hermes/このフォルダ内の「.env」フォルダを開いてください。

.envファイルでは各APIキーや設定値など環境変数を管理しています。

「GATEWAY_ALLOW_ALL_USERS」という設定値を検索してください。

デフォルトではfalseとなっているはずなので、これをtrueにします。

修正が完了したら、以下のコマンドでHermesゲートウェイを再インストールします。

hermes gateway uninstall

hermes gateway installこれでhermesは起動しなくてもPCの裏側で時間を見ながら定期実行してくれます。(PCは起動してください)

手動で設定も可能

チャットを通してAIが適切に設定してくれますが、もちろん手動で設定することもできますし、現在どのような設定になっているかを確認することもできます。

cd ~/.hermes/このフォルダ内にHermes Agentの情報が格納されています。

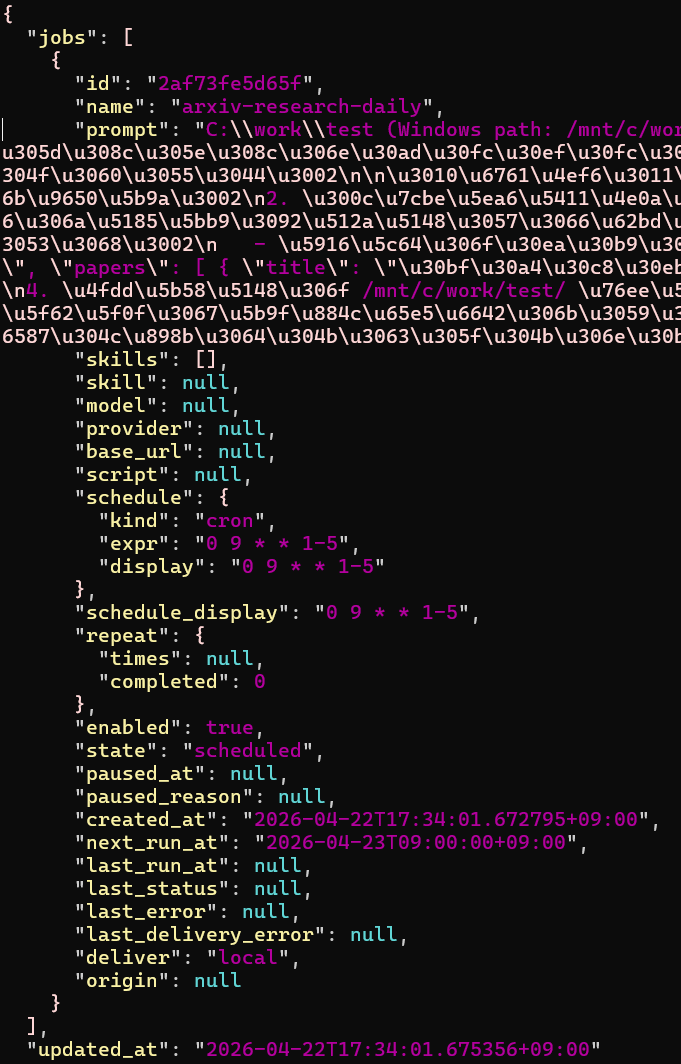

cronフォルダが先ほどの定期実行タスクを登録するフォルダですね。

jobs.jsonというファイルが格納されているので見てみましょう。

ここで注意が必要なのが、タイムゾーンがUTCのため、日本時間(JST)に合わせる必要があります。

チャットで指示しても直してくれますが、せっかくなので手動で修正しましょう。

cron式の「0 9 * * 1-5」を「0 0 * * 1-5」とすればOKです。

またmemoriesフォルダ内には、チャット内容からユーザーの特徴をmarkdown形式で記録してくれます。

ある程度会話すると記録されていくので、時々覗いてみてください。

まとめ

今回はHermes Agentの設定方法と使い方について紹介してみました。

これまでは単一のチャットでしかやり取りできなかったAIでしたが、Hermes Agentはより身近で高機能、かつ自分好みに自動でカスタマイズされます。

何か日ごろのタスクで定期的に行っているものや、自分独自の情報に基づくものがあれば、Hermes Agentを試してみてはいかがでしょうか?

以下はHermes Agentの学習パスなので、参考にしてみてください。

ここまでご覧いただきありがとうございました!